-

Energia e AI. La rete elettrica è il nuovo choke point

La crescita dell’intelligenza artificiale dipende da fattori molto più concreti dei singoli modelli e dei chip. Dipende dalla potenza elettrica disponibile, dalla sua continuità e dalla sua distribuzione geografica. L’energia è diventata il vincolo strutturale che nessuno voleva sentir nominare.

-

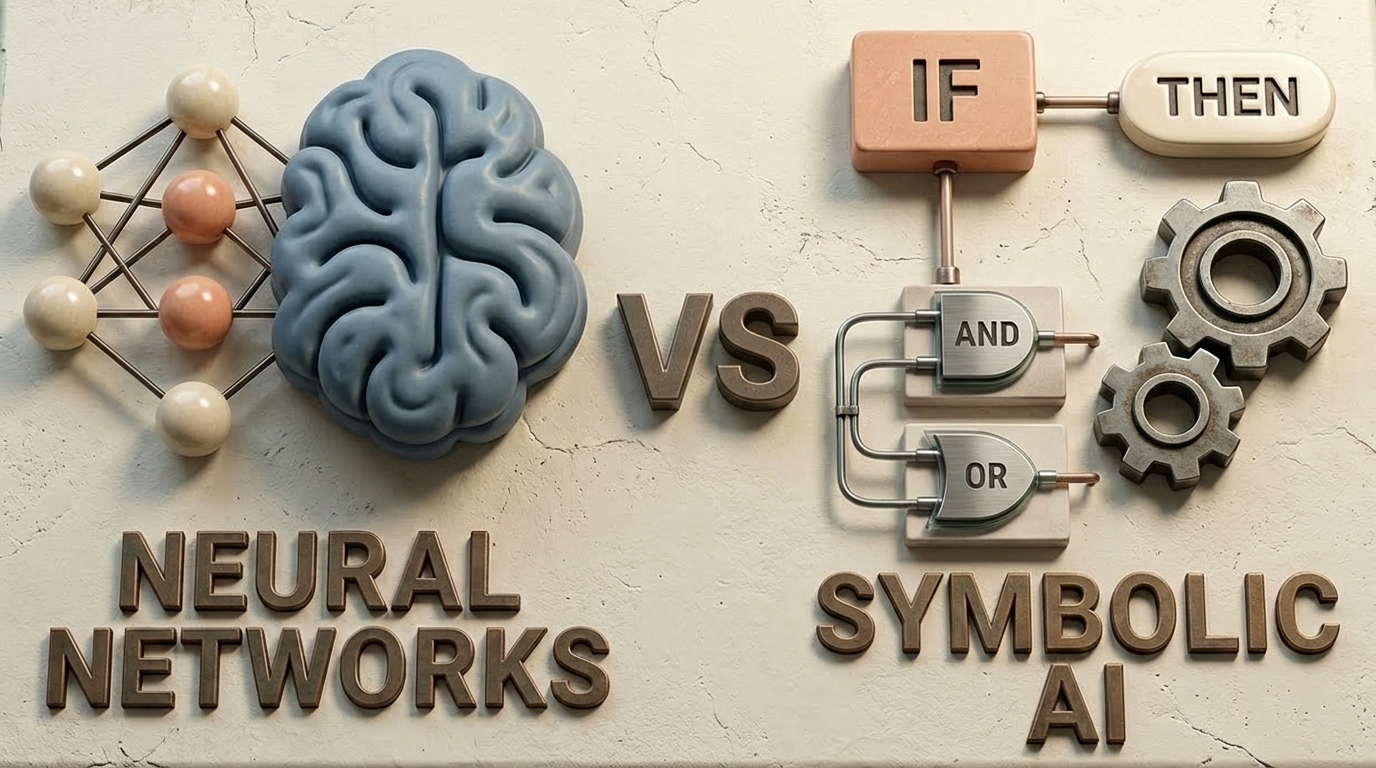

Neuro-symbolic AI oltre l’hype. Cosa indica davvero il caso Tufts sull’efficienza dell’AI

Una ricerca della Tufts University dimostra che, in un compito robotico strutturato, un’architettura neuro-simbolica può battere un modello Vision-Language-Action sia sul piano della riuscita sia su quello dei consumi energetici.

Brevi

-

Mianyang, la fusione laser cinese e il nuovo confine del potere tecnologico

Il grande impianto in costruzione nel Sichuan mostra come la frontiera della fusione non sia più soltanto una promessa energetica. Ricerca scientifica, simulazione estrema, deterrenza nucleare e competizione tra potenze si muovono ormai nello stesso spazio strategico.

-

Google presenta Virgo per l’Ai su Megascala

Nel confronto tra hyperscaler per il controllo dello stack dell’intelligenza artificiale, Google punta sull’integrazione verticale tra chip proprietari, rete, storage e servizi cloud.

-

Oltre gli LLM. La strategia tecnologica del Dragone tra AI, compute, sovranità digitale e competizione geopolitica

Pechino non sta puntando solo sugli LLM. Sta cercando di costruire un ecosistema tecnologico integrato nel quale AI, chip, reti, energia e regolazione si rafforzino a vicenda, riducendo le dipendenze esterne e aumentando la leva strategica dello Stato.

-

Analisti UBS: gli agenti AI aumentano la pressione competitiva sul software enterprise

La competizione AI si sposta dal livello dei modelli alle applicazioni aziendali.

-

Energia e AI. La rete elettrica è il nuovo choke point

La crescita dell’intelligenza artificiale dipende da fattori molto più concreti dei singoli modelli e dei chip. Dipende dalla potenza elettrica disponibile, dalla sua continuità e dalla sua distribuzione geografica. L’energia è diventata il vincolo strutturale che nessuno voleva sentir nominare.

-

Claude MYTHOS, il modello che non si può usare. Anthropic a caccia di Zero-Day.

Con Project Glasswing, Anthropic porta un modello general-purpose non rilasciato al pubblico all’interno di un programma di messa in sicurezza preventiva del software critico, nel punto di incontro tra intelligenza artificiale di frontiera, infrastrutture digitali e sicurezza nazionale.

-

AI di frontiera e difesa USA: la contesa è sul controllo

Il confronto tra Dipartimento della Difesa, Anthropic, OpenAI e Anduril mostra che la vera posta in gioco non è soltanto l’uso dell’intelligenza artificiale in ambito militare, ma chi abbia il potere di fissarne i limiti operativi, contrattuali e istituzionali.

-

OpenAi accelera sugli AI Agents

La rivalità nel campo dell’intelligenza artificiale si è ormai spostata dai chatbot generalisti a sistemi sempre più “agentici”. Un cambio di rotta che ha implicazioni dirette sia nel mercato enterprise, sia l’organizzazione stessa del lavoro digitale.

-

Neuro-symbolic AI oltre l’hype. Cosa indica davvero il caso Tufts sull’efficienza dell’AI

Una ricerca della Tufts University dimostra che, in un compito robotico strutturato, un’architettura neuro-simbolica può battere un modello Vision-Language-Action sia sul piano della riuscita sia su quello dei consumi energetici.

-

OpenAI annuncia il ritiro di Sora e rialloca le priorità

L’annunciato ritiro di Sora conferma il passaggio di OpenAI da una fase di espansione sperimentale multidirezionale a una strategia più selettiva. L’azienda sembra infatti ormai orientata verso una maggiore attenzione ai prodotti enterprise, agli strumenti di coding e all’integrazione delle funzionalità in un ecosistema più unificato.

-

Articolo 50, contenuti AI e trasparenza: cosa cambia dal 2 agosto 2026

Dal 2 agosto 2026 non scatterà un obbligo generalizzato di etichettare qualsiasi uso dell’intelligenza artificiale. Entreranno invece in applicazione obblighi di trasparenza selettivi, costruiti in modo diverso per provider e deployer.

-

Anthropic e il confine del potere: chi governa davvero l’AI di frontiera?

26 marzo 2026. Un tribunale federale del Northern District of California concede ad Anthropic un’ingiunzione preliminare contro il Dipartimento della Difesa degli Stati Uniti (DoD), sospendendo in via cautelare la designazione dell’azienda come “supply-chain risk”.